Bir yapay zeka ajanı size harika görünen bir çıktı sundu, ama içinde kritik bir hata var. Peki ya ajan bu hatayı kendisi fark edip düzeltebilseydi? İşte ajanın kendi çıktısını kontrol etmesini sağlayan öz denetim tasarımı tam olarak bunu hedefliyor. Bu mimari yaklaşım, LLM tabanlı ajanların ürettikleri içeriği değerlendirmesini, eleştirmesini ve gerektiğinde revize etmesini mümkün kılıyor.

Kısa Tanım: Öz denetim (self-supervision), bir yapay zeka ajanının kendi çıktısını analiz ederek hataları tespit etmesi, eksiklikleri belirlemesi ve otomatik düzeltme yapması sürecidir. İnsan müdahalesi olmadan “düşün-eleştir-düzelt” döngüsü oluşturur.

Öz Denetim Neden Kritik Bir İhtiyaç?

Standart LLM’ler tek seferde yanıt üretir ve bu yanıtın kalitesi tamamen ilk denemeye bağlıdır. Pratikte en sık görülen sorunlar şunlar:

- Halüsinasyon: Gerçek olmayan bilgilerin özgüvenle sunulması

- Mantık hataları: Adım adım çözümlerde tutarsızlıklar

- Bağlam kaybı: Uzun görevlerde önceki bilgilerin unutulması

- Format uyumsuzluğu: İstenen çıktı yapısına uymama

Öz denetim mekanizması bu sorunları minimize ediyor. Güncel araştırmalar, self-reflection (öz yansıtma) kullanan ajanların karmaşık görevlerde %15-30 daha yüksek doğruluk oranına ulaştığını gösteriyor.

Öz Denetim Tasarımının Temel Bileşenleri

Etkili bir öz denetim sistemi üç ana katmandan oluşur:

1. Üretim Katmanı (Generator)

Ajanın ilk çıktıyı oluşturduğu aşama. Burada standart bir LLM çağrısı yapılır ve ham yanıt elde edilir.

2. Eleştiri Katmanı (Critic)

Üretilen çıktının sistematik olarak değerlendirildiği aşama. Eleştiri modülü şu soruları yanıtlar:

- Çıktı verilen göreve uygun mu?

- Mantıksal tutarlılık sağlanmış mı?

- Eksik veya hatalı bilgi var mı?

- Format gereksinimleri karşılanmış mı?

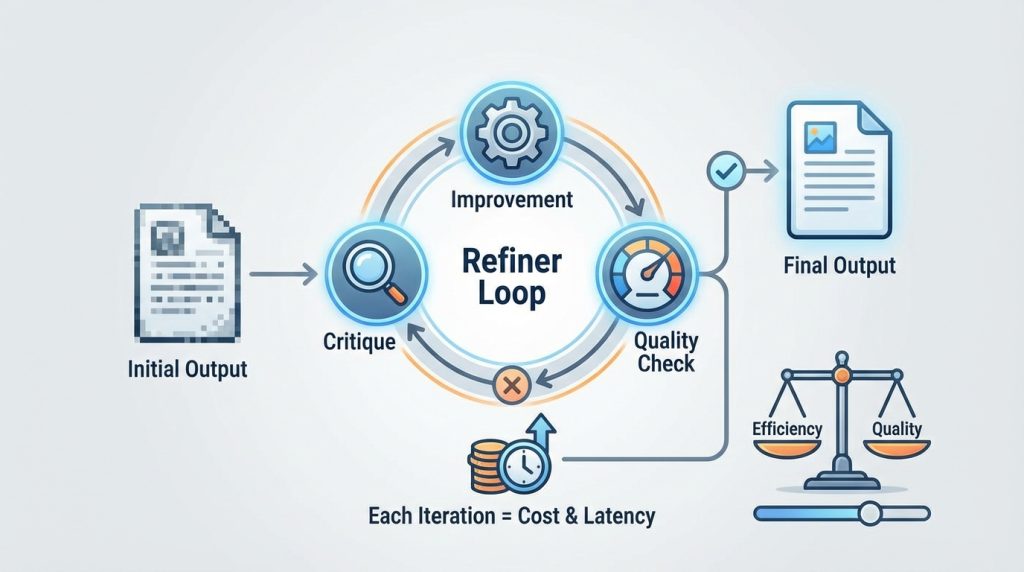

3. Revizyon Katmanı (Refiner)

Eleştiri sonuçlarına göre çıktının iyileştirildiği aşama. Bu döngü, belirlenen kalite eşiğine ulaşılana veya maksimum iterasyon sayısına erişilene kadar devam eder.

Kilit Çıkarım: Her iterasyon ek bir LLM çağrısı demek. Bu da maliyet ve gecikme anlamına geliyor. Tasarımda verimlilik-kalite dengesi kritik.

Popüler Öz Denetim Tasarım Kalıpları

| Tasarım Kalıbı | Çalışma Prensibi | En Uygun Senaryo | Maliyet Etkisi |

|---|---|---|---|

| Reflexion | Sözel geri bildirim ile öğrenme, hafıza kullanımı | Çok adımlı problem çözme | Orta-Yüksek |

| Self-Refine | Tek ajan, kendi çıktısını iteratif iyileştirme | Metin üretimi, kod yazımı | Orta |

| Debate (Tartışma) | İki ajan karşıt görüşleri savunur | Karar verme, doğrulama | Yüksek |

| Constitutional AI | Önceden tanımlı kurallara göre denetim | Güvenlik, etik uyumluluk | Düşük-Orta |

Reflexion Mimarisi Detayı

Stanford ve Google araştırmacılarının geliştirdiği Reflexion, öz denetimde ezber bozan bir yaklaşım sunuyor. Ajan, başarısız denemelerin “sözel hafızasını” tutuyor ve sonraki girişimlerde bu deneyimlerden yararlanıyor. Testlerde, bu yöntem HumanEval kod benchmark’ında %91 başarı oranına ulaşmış durumda.

Self-Refine Döngüsü

Daha basit ama etkili bir yaklaşım. Tek bir model hem üretici hem eleştirmen rolünü üstleniyor:

- İlk çıktıyı üret

- Çıktıyı eleştir, sorunları listele

- Eleştiriye göre revize et

- Kalite yeterliyse dur, değilse 2. adıma dön

Pro İpucu: Self-Refine için maksimum 3 iterasyon genellikle yeterli. Daha fazlası nadiren anlamlı iyileşme sağlıyor ama maliyeti ikiye katlıyor.

Nerede Kullanılır?

Öz denetim tasarımı şu alanlarda yoğun şekilde uygulanıyor:

- Kod üretimi: Syntax hatalarını ve mantık açıklarını yakalama

- Araştırma asistanları: Kaynak doğrulama ve tutarlılık kontrolü

- Müşteri hizmetleri botları: Yanıt kalitesi ve politika uyumu

- İçerik moderasyonu: Zararlı içerik tespiti ve filtreleme

- Veri analizi: Hesaplama doğruluğu ve sonuç yorumlama

Basit Örnek: Kod Üretiminde Öz Denetim

Bir kullanıcı “Python’da Fibonacci dizisi üreten fonksiyon yaz” dediğinde:

- Üretim: Ajan ilk kodu yazar

- Eleştiri: “Edge case’ler ele alınmış mı? Negatif sayı girilirse ne olur?”

- Revizyon: Input validation eklenir, docstring yazılır

- Son kontrol: Kod çalıştırılır, çıktı doğrulanır

Doğru Bilinen Yanlışlar

- “Öz denetim her zaman doğru sonuç verir”: Hayır. Ajan kendi hatalarını her zaman fark edemez. Özellikle bilgi doğruluğu konusunda dış kaynak doğrulaması şart.

- “Daha fazla iterasyon = daha iyi sonuç”: Belirli bir noktadan sonra getiri azalır, hatta model kendi kendine “aşırı düzeltme” yaparak kaliteyi düşürebilir.

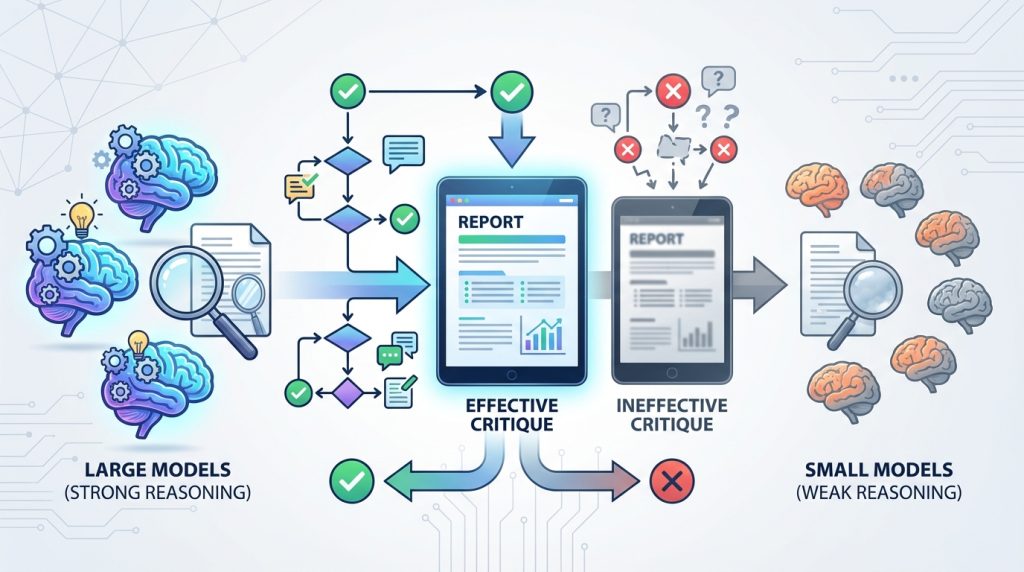

- “Tek bir model yeterli”: Karmaşık görevlerde farklı modellerin üretici ve eleştirmen rollerini üstlenmesi daha etkili sonuç veriyor.

Uygulama Stratejileri ve Dikkat Edilecekler

Öz denetim sistemi kurarken şu faktörleri göz önünde bulundurun:

Maliyet: Her eleştiri-revizyon döngüsü ek API çağrısı demek. Ortalama bir Self-Refine uygulaması, tek seferlik üretimin 2-4 katı token tüketir.

Süre: Gerçek zamanlı uygulamalarda gecikme kritik. 3 iterasyonlu bir döngü, yanıt süresini 3-5 saniyeden 10-15 saniyeye çıkarabilir.

Risk Seviyesi: Düşük. Öz denetim genellikle çıktı kalitesini artırır, ancak “over-correction” (aşırı düzeltme) riski var. Durdurma koşullarını net tanımlayın.

Sıkça Sorulan Sorular

Öz denetim ile fine-tuning arasındaki fark nedir?

Fine-tuning modelin ağırlıklarını kalıcı olarak değiştirir, öz denetim ise çalışma zamanında (runtime) çıktıyı iyileştirir. İkisi birbirini tamamlayan yaklaşımlar.

Hangi LLM’ler öz denetim için daha uygun?

Güçlü muhakeme yeteneğine sahip modeller (GPT-4, Claude 3, Gemini Ultra) daha etkili eleştiri üretiyor. Küçük modeller eleştirmen rolünde yetersiz kalabiliyor.

Öz denetim olmadan ajan kullanılabilir mi?

Evet, basit görevlerde tek seferlik üretim yeterli olabilir. Ancak kritik uygulamalarda (tıbbi bilgi, finansal analiz, kod üretimi) öz denetim şiddetle tavsiye ediliyor.

Açık kaynak araçlar var mı?

LangGraph, öz düzeltme döngüleri için popüler bir framework. Reflexion ve Self-Refine için de GitHub’da referans implementasyonlar mevcut.

Sonuç

Yapay zeka ajanlarında öz denetim tasarımı, “üret ve unut” yaklaşımından “üret, değerlendir, iyileştir” döngüsüne geçişi temsil ediyor. Bu mimari, ajanların daha güvenilir, tutarlı ve kaliteli çıktılar üretmesini sağlıyor.

Uygulamaya geçerken şunları aklınızda tutun:

- Basit görevler için Self-Refine, karmaşık görevler için Reflexion veya Debate kalıplarını değerlendirin

- Maksimum iterasyon sayısını 3-4 ile sınırlayın

- Maliyet-kalite dengesini sürekli izleyin

- Kritik bilgi doğrulaması için dış kaynak entegrasyonu ekleyin

Öz denetim, yapay zeka ajanlarını daha “düşünceli” hale getiren temel bir tasarım prensibi. Doğru uygulandığında, insan denetimi ihtiyacını azaltırken çıktı kalitesini önemli ölçüde artırıyor.

Cevap ver